- Система мониторинга

- Диагностика в командной строке

- Тесты base

- Тесты asr_billing

- check_billing_db_size.sh

- check_critical_jobs.sh

- check_events_stack_compact_count.sh

- check_events_stack_count.sh

- check_events_stack.py

- check_error_oss.sh

- check_error_django.sh

- check_error_voip_radius.sh:

- check_critical_pumper.sh

- check_error_paysystems.sh

- check_error_worker.sh

- test_httpd.sh

- check_interbase_log.sh

- test_free_space.sh

- test_radius_nas_list.sh

- test_radius.py

- check_billing_radius_acc_netstat.sh

- test_daemons.sh

- test_oss_daemons.sh

- ALARM Billing Не настроены реквизиты доступа к администраторской панели для тестирования

- FATAL Billing Error copy metadata

- ALARM /usr/local/bin/sync_nas! Не могу получить списки

- WARNING Обнаружены ошибки удаления абонентов

- WARNING Billing Не работает платежная система в asr_billing

- Тесты asr_cabinet

- Тесты asr_fiscal

- Тесты collector

- check_nf_collector_listen.sh

- check_critical_traf_reporter.sh

- check_bstat_check_raw_stat.sh

- check_bstat_many_raw.sh

- check_disk_space_stat.sh

- check_error_bstatd.sh

- Тесты xge

- Общие ошибки продуктов на платформе Carbon PL5

- ALARM Ошибка автоматической резервной копии!

- ALARM Не обнаружен работающий UPS

- ALARM Мало свободного места на диске!

- ALARM app заблокирован в течении минут

- ALARM CRITICAL carbon_update скрипт обновления завершился

- ALARM Повышенная нагрузка на некоторые ядра

- ALARM Billing Watchdog не активен в течение двух часов!

- ALARM Обнаружен другой работающий watchdog

- ALARM Reboot! Не могу записать в /tmp/softdog_agent.tmp

- WARNING Не запущен kdump

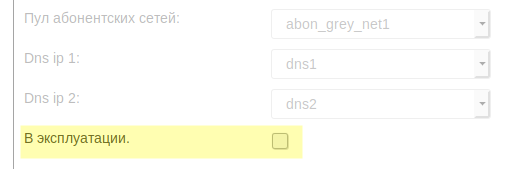

- WARNING Не доступны DNS серверы

- ALARM Billing Сбились настройки coredump

- Диагностика в веб-интерфейсе

Система мониторинга

На платформе Carbon PL5 существует система автоматического тестирования, запускающая тесты всех контейнеров раз в 10 минут. При возникновении ошибки по любому из тестов, создаётся заявка в портале HelpDesk. Помимо тестов server_check существуют так же тест выгрузки резервных копий на FTP и тест на наличие UPS. Также каждые 6 часов, в 5-ю минуту запускается тест monitoring, который запускает проверку всех контейнеров биллинга.

Запуск проверки вручную

Проверку можно запустить вручную, выполнив команду server_check в терминале или открыв диагностику в веб-интерфейсе.

Диагностика в командной строке

1. При каких либо сбоях требуется проверить состояние сервера и работу всех служб. Делается это командой

server_check

В ответ будет выведено состояние всех служб биллинга. Все службы должны иметь состояние [ OK ].

2. Для проверки базы можно посмотреть логи которые ведет система:

лог базы биллинга

cat /app/asr_billing/var/log/firebird/firebird.log

В выводе особое внимание обратить на строки содержащие примерно такие блоки текста

2.1. Повреждена целостность БД, серьезный сбой. Вероятно потребуется восстановление из бекапа:

Database: /mnt/var/db/billing.gdb database file appears corrupt (/mnt/var/db/billing.gdb) wrong page type page 1647 is of wrong type (expected 7, found 5) internal gds software consistency check (error during savepoint backout (290), file: exe.cpp line: 4026)

2.2. Биллинг не может найти БД, вероятно биллинг в safemode:

Database: /mnt/var/db/billing.gdb I/O error for file "/mnt/var/db/billing.gdb" Error while trying to read from file No such file or directory

2.3. Отдельная запись в таблице помечена как поврежденная:

Database: /mnt/var/db/billing.process.gdb.13836

Record 1002 is marked as damaged in table RDB$RELATIONS (6)

Тесты base

check_free_inodes.sh

- check_free_inodes.sh: ERROR(254) [FAILED]

/dev/md5 9125888 8581637 544251 95% /mnt/var

ALARM Мало свободных inode

ALARM На одном из устройств осталось мало свободных inode. Возможно какая-то папка забита большим количеством файлов

Ошибка говорит о том, что на одном из дисков слишком много файлов, в результате чего переполнена база файловой системы (inodes).

Для решения проблемы попробуйте перезагрузить сервер - возможно какой-то процесс создал много файлов, удалил, но до сих пор держит их в памяти.

Если перезагрузка не решила проблему, необходимо опеределить где слишком много файлов и удалить лишнее.

Воспользуйтесь утилитой tree, запустив её на указанный раздел:

tree /mnt/var/ | tail -n 1

Вывод будет преблизительно следующим:

39143 directories, 8730047 files

После чего нужно посмотреть сколько занято подпапками:

find /mnt/var -maxdepth 1 -type d | grep -v /$ | while read path; do echo $path; tree $path | tail -n 1; done

И так постепенно можно найти папки в которых находится более всего файлов. Что делать с файлами зависит от конкретной ситуации.

Если лишних файлов не оказалось, - их просто много -, возможно стоит пересоздать файловую систему, зарезервировав под БД файлов больший процент раздела передав команде mkfs параметр -N.

Возможно получится увеличить число inode без пересоздания утилитой tune2fs с ключем -m

Как временно перерести данные Вы можете узнать в разделе "Замена оборудования". Полную информацию по параметрам утилит mkfs и tune2fs Вы можете найти в их справочном руководстве: man mkfs.ext4, man tune2fs

Возмжно предварительно потребуется установить команду man:

yum install -y man |

check_apps_not_destroyed.sh

- check_apps_not_destroyed.sh: ERROR(2) [FAILED]

ALARM Некорректное состояние аппов

Обнаружены следующие аппы в состоянии destroy, которые должны быть включены:

collector

Требуется перезапустить их с помощью /etc/init.d/apps restart

Ошибка говорит о том, что какая-то из подсистем (контейнеров) платформы Carbon остановлена и "разрушена" - под этим понимается что контейнер остановлен и все точки монтирования внутри контейнера размонтированы.

Возможные причины:

- Сервер был перезагружен некорректно, без остановки биллинга по статье "Выключение, перезагрузка сервера"

- Ведутся сервисные работы, изменяется конфигурация (например добавляются диски для расширения пространства под какие-либо данные) контейнера

- При "сборе" контейнера произошла ошибка и какие-то разделы внутри него сервисный скрипт не смог замонтировать

- Произошла какая-либо иная ошибка при старте системы, из-за которой работа сервисного скрипта запускающего платформу Carbon завершилась некорректно (например, если на диске были обнаружены ошибки и системная утилита mount не смогла собрать контейнер)

Для отладки в первую очередь можно попробовать запустить команду build:

/app/collector/service build

И посмотреть каким будет вывод, исходя из этого пути решения могут быть разными. Ниже рассмотрены возможные проблемы.

Ведутся сервисные работы

Сообщите, пожалуйста, в автоматической создавшейся заявке, что ведутся работы.

Ошибка при сборке контейнера

Попробуйте найти в журнале сервисного скрипта информацию когда контейнер с котором произошла ошибка запускался:

[root@Billing5 ~]# grep collector /var/log/apps.log | tail -n 2

Sat Mar 23 17:06:56 +08 2019 collector stop STOPPING

Sat Mar 23 17:07:01 +08 2019 collector stop OK

По данному времени попробуйте найти информацию в логах загрузки (сохраняются в папке /var/log/boot/) и в системном логе */var/log/messages и архивных логах:

cat /var/log/messages*

Возможно в файлов логов удастся найти информацию об ошибках файловой системы или некорректном завершении процессов по котором удастся понять причину почему не запустился контейнер.

Ошибка монтирования

/app/collector build mount: no such partition found # /app/collector/service build: [FAILED]

Необходимо проверить, чтоб файлы в данном контейнере не были заблокированы или использовались каким-либо пользователем в системе.

В конфигурационном файле collector настроено сохранение детальной статистики на отдельный диск:

# grep mount /app/collector/cfg/config declare -A mount mount['1statfs']='-U a7a26c14-e788-40a0-b0f9-f051be5c9e61 /app/collector/var/stat' mount['2statfsnfsen']='--bind /app/collector/var/stat/nfsen_stat /app/collector/var/nfsen_stat' mount['3statfsncapdndump']='--bind /app/collector/var/stat/nfcapd_dump /app/collector/var/nfcapd_dump' mount['proc']='-t proc none /proc'

Но раздела с ID a7a26c14-e788-40a0-b0f9-f051be5c9e61 нет в системе:

[root@st-rline ~]# blkid | grep a7a26c14-e788-40a0-b0f9-f051be5c9e61 -c 0

Весьма вероятно что конфигурационный файл перенесли с другого сервера, но диск на который ранее сохранялась статистика не подключили. Вариантов решения несколько:

- Выключите сервер, подключите диск, включите сервер

- Настройте сохранение на другой выделенный диск или раздел

- Уберите настройку выделенного раздела из конфигурационного файла

check_loadaverage.sh

- check_loadaverage.sh: ERROR(2) [FAILED]

ALARM Высокий load average

12:15:09 up 223 days, 1:07, 2 users, load average: 2.56, 6.35, 12.45

2.56 6.35 12.45 3/584 32535

Возможные причины:

- Запущены процессы, которые активно используют ресурс CPU.

- Аппаратные проблемы с жёсткими дисками.

- Часть запущенных процессов активно использует жёсткие диски

- На сервере мало свободной оперативной памяти и активно используется swap

- На сервере чрезвычайно много зависших процессов (run/total: 3/584)

- Сервер взломан и используется для майнинга криптовалюты.

- Если есть открытая автозаявка 'Повышенная нагрузка на некоторые ядра процессора'

нужно сперва решить её.

Полезные команды для отладки: free, top, iotop

Информация о потреблении ресурсов CPU записана в /app/base/var/log/check_loadaverage.log

Его можно проанализировать командой:

/app/base/usr/local/bin/analyze_check_loadaverage_log.sh --analyze

2019-10-16 12:15:09: pl5angel ALARM Высокий load average

load average показывает очередь к CPU на выполнение запущенных процессов. Оно не должно превышать количество потоков. Если Вы столкнулись с такой проблемой, попробуйте проанилизровать лог: в него записывается вывод команды ps -aux при срабатывании теста:

/app/base/var/log/check_loadaverage.log

- Анализ можно провести специальным скриптом:

/app/base/usr/local/bin/analyze_check_loadaverage_log.sh --analyze

- В начале вывода Вы увидите историю срабатывания автотеста, например:

/app/base/usr/local/bin/analyze_check_loadaverage_log.sh --analyze [3588] START Всего 14 срабатываний Срд Окт 16 12:11:59 +05 2019 ALARM load average 0.62 0.79 0.69 Срд Окт 16 12:13:01 +05 2019 ALARM load average 0.28 0.65 0.64 Срд Окт 16 12:13:04 +05 2019 ALARM load average 0.25 0.64 0.64 Сбт Окт 19 05:05:56 +05 2019 ALARM load average 2.69 1.76 1.03 Сбт Окт 19 05:06:10 +05 2019 ALARM load average 3.72 2.02 1.13

Так можно понять, часто ли возникает проблема и в какие промежутки времени - постоянно, или систематический в какое-то время, или это совершенно случайные события.

- Дале тест выводит топ 10 задач, нагружавших процессор по каждлому случаю, например:

lavg.3588/Пнд_Окт_21_16_03_12_+05_2019.ps top 15/41 root 31910 26.4 1.3 202476 77840 ? R 16:03 0:02 python2.7 /usr/local/www/sites/manage.pyc rebuild_index --noinput root 32670 24.5 1.1 373960 66080 ? Sl 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/paysystemsd.py start 496 28833 22.3 5.3 3623268 310300 ? Sl 16:02 0:09 /usr/bin/java root 32414 21.0 1.2 302804 71928 ? R 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/worker.py start root 359 17.0 0.6 269960 40848 ? R 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/felicitation_daemon.py start root 372 16.0 0.6 269568 40256 ? R 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/jobs_daemon.py start root 31869 8.0 1.1 376156 68492 ? Rl 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/msgd.py start root 31904 6.9 1.1 299644 69276 ? S 16:03 0:00 /usr/bin/python2.7 /usr/local/sbin/worker.py start root 28885 5.0 1.7 353852 103944 ? S 16:02 0:02 uwsgi --ini /etc/uwsgi.ini 495 32426 5.0 0.2 67592 12320 ? Ss 16:03 0:00 fb_inet_server root 28883 4.3 1.6 346740 96728 ? S 16:02 0:01 uwsgi --ini /etc/uwsgi.ini 495 32301 4.4 0.1 66948 10048 ? Ss 16:03 0:00 fb_inet_server root 31899 3.3 0.3 122752 19508 ? S 16:03 0:00 python2.7 /usr/local/bin/elasticsearch_reindex.py root 29861 3.6 1.2 293252 71728 ? S 16:02 0:01 python2.7 /mnt/var/oss/core/Smotreshka_test/init.d/lifestream_sync root 28886 3.3 1.2 310988 74240 ? R 16:02 0:01 uwsgi --ini /etc/uwsgi.iniПоняв что за процессы создают максимум нагрузки, можно попробовать:

- Проанализировать их лог (если есть), посмотреть что они делали в указанное время

- Возможно работа этих процессов завязана на системные ресурсы, которых им не хватает - ОЗУ, скорость работы дисков и тд.

- Если используется SSD, убедитесть что диск производительный по современным меркам: более 50 000 IOPS на запись и чтение, ресурс по крайней мере 300TB, используемые чипы памяти SLC, MLC или TLC

- Если используется аппаратный RAID-контроллер, то установлена BBU (батарея для сохранения кеша записи при отключении питания) - её отсутствие заметно снижает производительность дисковой подсистемы.

- Если у вас все диски подключены к аппаратному RAID - выделите под статистику отдельный виртуальный диск, с ограниченным кешем, в противном случае постоянно поступающая статистика будет заполнять кеш контроллера, снижая производительность

- Подключите отдельные диски под детальную статистику, логи (можно один диск на логи и статистику) и базу данных

- Убедитесь, что используется производительный RAID: например, если диски собраны в RAID-6 – это надежный, но весьма медленный вариант, его можно использовать для хранения детальной статистики. Систему и БД лучше держать на RAID10

Недостаточно быстрые диски

Одной из основных проблем замедления работы является недостаточно производительные диски. Это можно проверить так:

awk '($0~"ALARM load average" || $8=="D")' /app/base/var/log/check_loadaverage.log | less

Если в выводе будет множество процессов в состоянии "D" (непрерываемй сон, состояние в котором процесс ожидает некоторое реакции ядра ОС и при этом не может быть прерван), это с вероятностью 99.9% говорит о недостаточной производительности дисков. Пример такого вывода:

Срд Окт 16 09:30:12 +05 2019 ALARM load average 22.44 23.59 20.60 root 1147 0.0 0.0 0 0 ? D Mar07 48:34 [jbd2/sda3-8] root 1400 0.0 0.0 0 0 ? D Mar07 188:02 [flush-8:0] 51 4248 0.0 0.0 76552 4672 ? D 09:30 0:00 sendmail: [127.0.0.1]: idle root 6787 0.0 0.0 53596 3732 ? D 09:30 0:00 isql-fb 169.254.30.50:/var/db/billing.gdb -p -u SYSDBA root 6865 0.0 0.0 108696 1048 ? D 09:30 0:00 /bin/bash /usr/local/sbin/nas_command.sh 111 mikrotik.sh 1 root 6867 0.0 0.0 108412 800 ? D 09:30 0:00 /bin/bash /usr/local/sbin/nas_command.sh 106 mikrotik.sh 1 root 6874 0.0 0.0 108408 808 ? D 09:30 0:00 /bin/bash /usr/local/sbin/nas_command.sh 83 session 1 /var/oss/core/Megogo/bin root 6877 0.0 0.0 108644 980 ? D 09:30 0:00 /bin/bash /usr/local/sbin/nas_command.sh 97 mikrotik.sh 1 ....

Вывод сокращен, в действительности там еще около 30 строк с процессами в состоянии "D" и почти все они скрипты системы, получающие данные из БД биллинга.

Для решения проблемы потребовалось перенести базу на отдельный SSD диск с высокими показателями IOPS.

check_free_memory.sh

- check_free_memory.sh: ERROR(2) [FAILED]

ALARM Мало свободной памяти

Подробная информация записана в файл /app/base/var/log/check_free_memory.log

10

Тест пишет об ошибке когда на сервере осталось менее 20% свободной ОЗУ. SWAP при этом не учитывается.

Последняя строка в выводе ("10" в примере выше) - это процент свободной ОЗУ.

Диагностику можно посмотреть в логе:

/app/base/var/log/check_free_memory.log

Там Вы наёдете вывод двух команд, выполненных при наличии ошибки:

- ps axSk-rss -F - список запущенных процессов, отсортированных по объёму занимаемой памяти

- pstree -upal - список процессов в виде дерева

Как именно работает тест

Разберём на примере вывода команды free:

free -m | grep -E 'total|^Mem'

total used free shared buffers cached

Mem: 5707 5324 382 25 681 1412

Что делает тест:

- Получает количество памяти: в примере это total = 5707

- Вычисляет свободную папять: складывает free, buffers и cached, то есть 384+681+1412, получается 2477

- Получает свободную память в процентах: в примере выше - 2477*100/5707, получится 43%

- Если свободной памяти меньше 20%, то:

- Пишет диагностику в лог check_free_memory.log

- В логе системы монторинга сохраняется информация что тест завершился с ошибкой

- Если проблема повторится 5 раз за час, то создаётся автоматическая заявка.

Как понять на какие процессы ушла память?

Причины могут быть разными и зависить от конкретного процесса.

Методика определения причины:

- Убедитесь, что Ваш сервер соответствует системным требованиям:

- Количество ОЗУ достаточно

- Скорость работы ОЗУ сотвтетствует требованиям

- Процессор поддерживает работу с памятью на требуемой частоте

- Если с требованиями всё в порядке, обратитесь к логу check_free_memory.log, типичная ситуация когда 1-2 процесса требуют больше всего памяти

- Посмотрите что это за процессы и попробуйте найти в Google информацию о проблемах с назвапнием процесса и высоким потреблением памяти, например "mysqld high ram"

Что ещё может оказаться полезным:

- Убедитесь что занято не более 500Мб SWAP:

Команда

free -m | grep -E 'total|Swap'

Выводtotal used free shared buffers cached Swap: 5839 15 5824

- Если занято 300-500Мб, то это нормальная ситуация - некоторые системные программы и ядро могут использовать SWAP даже если есть свободная ОЗУ.

- Если занять более 500Мб - скорей всего ОЗУ системе уже недостаточно и нжуно анализировать на что она ушла, так как вместо части ОЗУ используется болеемедленный диск

- Посмотрите потребление памяти конкретного процесса по его PID. Используя пример с тем же mysql:

- Узнаем PID

Команда

ps aux | grep -E 'PID|/usr/libexec/mysqld.*port=3307' | grep -v grep

ВыводUSER PID %CPU %MEM VSZ RSS TTY STAT START TIME COMMAND 27 5064 0.0 0.5 377340 31624 ? Sl Jun05 2:43 /usr/libexec/mysqld --basedir=/usr --datadir=/var/lib/mysql ... --socket=/var/lib/mysql/mysql.sock --port=3307

- Посмотрим, занимает ли процесс место только в памяти, или ещё в SWAP

Команда

cat /proc/5064/status | grep -E 'VmSize|VmSwap'

ВыводVmSize: 377340 kB VmSwap: 0 kB

- Узнаем PID

Пример выше делали на виртуальной машине где нет какой-либо проблемы, поэтому SWAP не занят. В действитеильности, документацию писали по кейсу где MySQL локального сайта заняла 44% ОЗУ и ещё 2Гб в SWAP, что явно говорило о проблема где-то в этой части системы.

Тесты asr_billing

check_billing_db_size.sh

- check_billing_db_size.sh: ERROR(1) [СБОЙ ]

2017-03-03 13:38:47 Чрезмерно большая база данных биллинга

2017-03-03 13:38:47: /usr/local/monitoring/check_billing_db_size.sh ERROR(1): 2017-03-03 13:38:47 Чрезмерно большая база данных биллинга

Ошибка происходит при увеличении размера БД до 10Гб. Почему так происходит, описано в справочной документации firebird.

Со временем база может достичь данного размера по той простой причине, что место на диске не очищается при удалении записей из базы данных, так как это создаст лишнюю постоянную нагрузку на диск и ОЗУ. Записи в БД добавляются постоянно - любые события, происходящие с абонентами, их лицевыми считами, оборудованием, добавляются в стэк событий, обрабатываются воркером, после чего очищаются.

Для решения проблемы Вам необходимо создать резервную копию, после чего восстановиться с неё же.

check_critical_jobs.sh

- check_critical_jobs.sh: ERROR(2) [СБОЙ ]

ALARM Имеются критические ошибки в логе jobs_daemon за последний час: 5690

Тест сообщает что при выполнении запланированных задач произошла ошибка. Посмотреть описание ошибки можно в логе службы:

grep CRITICAL /app/asr_billing//var/log/jobs_daemon.log | cut -d' ' -f 8-100 | sort | uniq

Как найти проблемную задачу в биллинге

В сообщении об ошибке будет написан ID задачи. По нему можно определить на каком абоненте она была создана:

- Ошибка:

CRITICAL - Не удалось выполнить отложенную задачу id=20

- Создайте отчет в конструкторе, подставьте в него ID проблемной задачи из описания ошибки:

select a.contract_number from jobs_stack js join abonents a on js.abonent_id=a.id where js.id=20

- Выполните отчет и Вы узнаете номер договора абонента. Найдите его поиском

Некорректного заполнения параметров запланированной задачи: отчеты

CRITICAL - Не удалось выполнить отложенную задачу id=18 абонента Тестовый:Traceback (most recent call last): CRITICAL - Ошибка выполнения команды python2.7 /usr/lib/python2.7/site-packages/jobs_worker/jobs_scripts/make_reports.pyc abonent_id=812

Ошибка возникла из-за некорректного заполнения параметров запланированной задачи на выполнение отчета - не указан ID отчета.

Некорректного заполнения параметров запланированной задачи: рассылка сообщений

CRITICAL - Не удалось выполнить отложенную задачу id=20 абонента Исилькуль:/bin/sh: -c: line 0: syntax error near unexpected token `12' CRITICAL - Ошибка выполнения команды python2.7 /usr/lib/python2.7/site-packages/jobs_worker/jobs_scripts/message_sending.pyc admin_msg_id=<12> objects_status=<27> abonent_id=2471 job_id=20

Ошибка возникла из-за некорректного заполнения параметров запланированной задачи на рассылку сообщений - в параметрах задачи написали лишние символы кавычек "<" и ">"

Для решения - отредактируйте задачу, убрав ненужные символы и сохраните, сообщения отправятся.

Создана задача на выполнение отчёта. В sql запросе имеется ошибка.

CRITICAL - Не удалось выполнить отложенную задачу id=54 абонента Все:Traceback (most recent call last): CRITICAL - Ошибка выполнения команды python2.7 /usr/lib/python2.7/site-packages/jobs_worker/jobs_scripts/make_reports.pyc -r 1048 abonent_id=1 job_id=54

Здесь указан ID отчета, но всё равно фиксируется ошибка. Для подробной дигностики откройте лог в программе просмотра текста less и найдите ошибку:

less /app/asr_billing//var/log/jobs_daemon.log

Следующие строчки говорят о том, что в выбраном отчёте используются переменная Po_datu. Использование переменных допускается только в ручном выполнение отчёта.

2019-10-01 01:01:06,188 - worker - jobs_lib - CRITICAL - Не удалось выполнить отложенную задачу id=54 абонента Все:Traceback (most recent call last): File "//usr/lib/python2.7/site-packages/jobs_worker/jobs_scripts/make_reports.py", line 71, in <module> File "//usr/lib/python2.7/site-packages/jobs_worker/jobs_scripts/make_reports.py", line 48, in _run File "//usr/local/www/sites/admin/models/admin_custom_reports.py", line 23, in get_data File "//usr/local/www/sites/admin/models/admin_custom_reports.py", line 61, in _execute_sql KeyError: u'2.Po_datu|date'

Путей решения задачи два:

- Исправить параметры, указав верные

- Удалить запланированную задачу

check_events_stack_compact_count.sh

- check_events_stack_compact_count.sh: ERROR(1) [СБОЙ ]

Возникает при количестве событий больше 100000 в таблице events_stack_compact. В таблице events_stack_compact собираются события, связанные с отправкой команд на оборудование, но ещё не обработанные биллингом. Примеры состояния абонента и событий которые отправляются на оборудование после их обработки Вы можете посмотреть по ссылке.

Большое количество событий в таблице events_stack_compact может быть вызвано возрошей нагрузкой на биллинг. Например массовая авторизация абонентов при перезагрузке оборудования. При этом имеется проблема производительности сервера биллинга, в следтвии которой события не могут быть оперативно обработаны. Наблюдать за количеством событий можно с помощю следующего запроса.

# sqlexec "select count(*) from events_stack_compact"

COUNT

============

110249

Проверьте сервер биллинга на соответствие системным требованиям и проверьте, какие события собираются в стеке. Если количество не уменьшается, то создайте обращение на портале HelpDesk

Если в стеке скопились команды отправки на маршрутизаторы Mikrotik, проверьте количество записей в address list:

/ip firewall address-list print count-only Если количество несколько сотен тысяч, вероятно маршрутизатор интегрирован с Carbon Reductor для фильтрации по IP. В таком случае Вам нужно изменить способ инитеграции Микротика с Редуктором по статье "IP фильтрация MikroTik" |

check_events_stack_count.sh

- check_events_stack_count.sh: ERROR(1) [СБОЙ ]

2017-03-07 07:32:18 Очень большое количество команд в event_stack

В таблице events_stack собираются события для отправки на оборудования. Большое количество событий связано как правило с проблемами доступа на оборудование (nas недоступен, сменились какие-то параметры вроде логина/пароля/ip, оборудование не принимает CoA и тд). Так же, возможно, что проблема в медленном ответе биллингу от НАСа, так как команды отправляются в заданное количество потоков (по-умолчанию, 1) и каждая следующая выполняется только после ответа от сервера. Убедитесь, что нагрузка процессора и канала на NAS в норме.

Узнать количество скопившихся событий можно выполнив запрос к БД

# sqlexec "select count(*) from events_stack"

COUNT

============

122837

Если в стеке скопились команды отправки на маршрутизаторы Mikrotik, проверьте количество записей в address list:

/ip firewall address-list print count-only Если количество несколько сотен тысяч, вероятно маршрутизатор интегрирован с Carbon Reductor для фильтрации по IP. В таком случае Вам нужно изменить способ инитеграции Микротика с Редуктором по статье "IP фильтрация MikroTik" |

check_events_stack.py

Попробуйте оптимизировать отправку команд по статье: nas_event_daemon

Если в стеке скопились команды отправки на маршрутизаторы Mikrotik, проверьте количество записей в address list:

/ip firewall address-list print count-only Если количество несколько сотен тысяч, вероятно маршрутизатор интегрирован с Carbon Reductor для фильтрации по IP. В таком случае Вам нужно изменить способ инитеграции Микротика с Редуктором по статье "IP фильтрация MikroTik" |

check_error_oss.sh

Тест говорит о наличии ошибок синхронизации с сервисами IPTV:

- check_error_oss.sh: ERROR(2) [FAILED]

WARNING Ошибки при синхронизации оборудования

Не удалось выполнить синхронизацию команд с оборудованием OSS

За последний час CRITICAL: 6

За последний час ERROR: 0

Подробности в логе службы /app/asr_billing//var/log/oss.log

2019-05-07 10:01:00,717 1690 nas_event_daemon/lifestream CRITICAL Невозможно получить пользователей, т.к. не найден NAS

2019-05-07 10:10:59,813 - worker - v1 - CRITICAL - Невозможно получить пользователей, т.к. не найден NAS

2019-05-07 10:10:59,813 14711 nas_event_daemon/lifestream CRITICAL Невозможно получить пользователей, т.к. не найден NAS

2019-05-07 10:19:37,027 - worker - v1 - CRITICAL - Невозможно получить пользователей, т.к. не найден NAS

2019-05-07 10:19:37,027 25021 nas_event_daemon/lifestream CRITICAL Невозможно получить пользователей, т.к. не найден NAS

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-checkerroross.sh

Все возникшие проблемы можно увидеть в логе /app/asr_billing//var/log/oss.log.

Ошибки синхронизации могут возникнуть как со стороны Carbon Billing 5, так и со стороны сервиса телевидения. Необходимые действия для их устранения необходимо определить исходя из сообщений в логе.

Не найден NAS

2019-05-07 10:01:00,717 1690 nas_event_daemon/lifestream CRITICAL Невозможно получить пользователей, т.к. не найден NAS

В хранилище OSS схем (/app/asr_billing/var/oss/core) существует папка с OSS-схемой IPTV, при этом сам NAS не заведён в биллинге.

Для решения проблемы заведите NAS в биллинге или удалите OSS директорию.

Если удаляете OSS директорию NAS IPTV в каталоге /app/asr_billing/var/oss/core/, обязательно, после этого требуется выполнить перезапуск службы nas_event_daemon.

chroot /app/asr_billing/ service nas_event_daemon restart

Сервер ответил ошибкой

2019-05-07 10:04:37,126 15643 iptvportal_package.commands ERROR Сервер ответил ошибкой: {u'error': {u'message': u'null value in column "password" violates not-null constraint\nDETAIL: Failing row contains (1234567, null, null, null, null, null, 78, 12345678, null, f, null, null, 1, 2019-05-06 15:33:51.876434+03, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null, null).\n'}, u'id': 111, u'method': u'update'}, Url: https://admin.provider.iptvportal.ru/api/jsonsql/, Запрос: {"params": {"table": "subscriber", "set": {"password": null}, "where": {"eq": ["username", "12345678"]}, "returning": "id"}, "jsonrpc": "2.0", "id": 111, "method": "update"}, Авторизация: {'Iptvportal-Authorization': u'sessionid=kjdiv32ur9fksffopsdkfmv34k9r0efc'}

При обращении к API портала телевидения возникла ошибка из-за структуры запроса или данных переданных в запросе.

Как правило сервисы возвращают текст ошибки, в указанном примере это параметр message:

null value in column "password" violates not-null constraint

При изменении параметров учетной записе на портале телевидения, не был передан пароль - именно об этом говориться в сообщении об ошибке.

Исходя из полученной информации, можно попробовать решить проблему:

- В параметрах запроса видно что изменяли учтеную запись с логином "12345678" - можно попробовать найти её в биллинге и убедиться, что пароль не задан в самой учетной записи. В таком случае установите пароль и дождитесь следующей синхронизации.

- Ошибка может быть в самом обработчике отправляющем запросы на портал телевидения.

Нужно добавить префикс для логинов в настройках услуги!

Эта проблема может возникнуть для некоторых IPTV, например Смотрёшкой.

Настройте услуги телевидения, создающие учетную запись, по статье "Настройка услуг IPTV" - у всех таких услуг должен быть указан префикс для создаваемых логинов.

Логины учетных записей в биллинге и на портале не совпадают!

Включите опцию "ignore_username_difference" по статье Интеграция с LifeStream (Смотрёшка, Смотрешка)"

Неизвестный абонент на Stalker

iptvportal_package.commands ERROR Неизвестный абонент с ip=10.0.0.3 на Stalker, приставка mac=fe:54:00:ac:5b:e0

В процессе синхронизации биллинг нашел на Stalker абонентов с неизвестными ему связкой IP-адресам и MAC-адреса.

Для решения, актуализируйте данные по приставкам в биллинге или удалите устройство на портале.

Специфическая ошибка Смотрёшки

2020-04-13 12:01:03,366 - worker - lifestream_sync - ERROR - Произошла ошибка 2020-04-13 12:01:03,366 31543 nas_event_daemon/lifestream ERROR Произошла ошибка

В данном случае нужно смотреть полный лог Смотрёшки и анализировать конкретную ошибку.

Лог находится по пути /app/asr_billing/var/log/nas_event_daemon/lifestream.log

Во-первых можно попробовать воспроизвести ошибку: включите непрерывный мониторинг лога в одном терминале:

tail -f /app/asr_billing/var/log/nas_event_daemon/lifestream.log

И перезапустите сервер синхронизации в другом:

chroot /app/asr_billing/ service oss restart

Из полученного лога в первом терминале можно сделать какие-то выводы. Если происходит ошибка, в выводе можно будет увидеть команду которую выполнял биллинг и что получил в ответ. Например:

result.request.method=GET

result.request.url=https://best_isp.proxy.lfstrm.tv/v2/accounts?page_size=50000&page=0

result.request.body=None

result.status_code=500

result.content={"error": "argument of type 'NoneType' is not iterable"}

Получив вывод лога и возникшую ошибку, Вы можете обратиться в Смотрёшку и уточнить почему API вернул ошибку.

Смотрешка не принимает запросы от биллинга

В логе на котрый ссылается тест написано что просто произошла ошибка:

2021-02-01 15:36:30,970 - worker - lifestream_sync - ERROR - Произошла ошибка

Если посмотреть полный лок синхронизатора, можно увидеть следующее:

2021-02-01 15:36:30,969 - worker - commands - INFO - Запрос не принят сервером: Результат отправки запроса: result.request.method=GET result.request.url=https://lifestream.proxy.lfstrm.tv/v2/accounts?page_size=50000&page=0 result.request.body=None result.status_code=403 result.content={"error": "HTTP 403: Forbidden (Access from 192.168.10.1 is not allowed)"}

где 192.168.10.1 - адрес биллинга.

Данная ошибка означает, что Смотрешка не принимает запросы с ip 192.168.10.1. Для решения проблемы необходимо обратиться в техническую поддержку Смотрешки.

Учетки с email "user@example.com" нет на портале, создадим

2020-07-04 00:03:35,093 - worker - lifestream_sync - ERROR - Учетки с email "user@example.com" нет на портале, создадим

Ошибка говорит о том, что при синхронизации с сервисом телевидения, биллинг не обнаружил на портале учётную запись и создал её.

Если ошибка повторяется для одног о и того же пользователя, посмотрите полный лог, например так:

tail -n 100 /app/asr_billing/var/log/nas_event_daemon/lifestream.log

В логе должна быть более детальная информация почему произошла ошибка, Например:

2020-07-06 08:17:07,106 - worker - lifestream_sync - ERROR - Учетки с email "user@example.com"" нет на портале, создадим 2020-07-06 08:17:07,106 - worker - v1 - INFO - Получаем учетку из биллинга 2020-07-06 08:17:07,106 - worker - v1 - INFO - Подходящие учетки не найдены - ищем любые учетки привязанные к насу 1114 2020-07-06 08:17:07,114 - worker - v1 - INFO - Получили учетку из биллинга user_id=user100007 2020-07-06 08:17:07,114 - worker - commands - INFO - Command — get_portal_user - login=user100007 2020-07-06 08:17:07,277 - worker - commands - INFO - Запрос не принят сервером: Результат отправки запроса: result.request.method=POST result.request.url=https://bestisp.proxy.lfstrm.tv/v2/accounts result.request.body={"username": "user100007", "password": "123456", "email": "user@example.com""} result.status_code=400 result.content={"error": "HTTP 400: login: services.error.login.accounts.invalid_login"}

В логе видно, что Lifestream не принял запрос от биллинга с ошибкой 400 и коментарием "login: services.error.login.accounts.invalid_login".

Выше видно какие параметры отправлялись к сервису.

Подробную информацию по ошибке необходимо запросить у сервиса.

| Смотрёшка не даёт обновить email абонента во время синхронизации. Необходимо вручную изменить его в Смотрёшке. |

iptv24tv_sync - ERROR - Произошла ошибка: ('Cursor.fetchone:\n- SQLCODE: 303\n Dynamic SQL Error\n- SQL error code = -303 ...)

Если в логе возникает ошибка вида:

2022-07-07 08:59:30,515 - worker - iptv24tv_sync - ERROR - Произошла ошибка: ('Cursor.fetchone:\n- SQLCODE: -303\n- Dynamic SQL Error\n- SQL error code = -303\n- arithmetic exception, numeric overflow, or string truncation\n- string right truncation', -303, 335544569)

Это означает что в БД биллинга поступают запросы от сервиса 24ТВ с логином, не соответствующим размеру поля логина в БД биллинга. Такие запросы генерируются из-за абонентов на портале IPTV у которых нет реквизитов email или телефон. Данная ошибка будет исправлена в новых версиях. Если столкнулись с данной проблемой - создайте обращение на портале HelpDesk.

check_error_django.sh

- check_error_django.sh: ERROR(2) [СБОЙ ]

WARNING Имеются ошибки в логе /var/log/django/error.log за последний час: 1

Причин возникновения этой ошибки может быть несколько и иногда они требуются анализа отделом разработки, однако если посмотреть какие именно были ошибки возможно получится отладить их без привлечения разработчика. Ниже приведено решение нескольких типичных проблем.

Ошибка web_api_get

2018-11-15 20:45:08,307 - django - handlers - ERROR - Exeption:'NoneType' object has no attribute '__getitem__' 'NoneType' object has no attribute '__getitem__'

2018-11-15 20:45:08,307 - django - handlers - ERROR - 'NoneType' object has no attribute '__getitem__' 'NoneType' object has no attribute '__getitem__'

2018-11-15 20:45:08,307 - django - handlers - ERROR - traceback: ['Traceback (most recent call last):\n', ' File "//usr/local/www/sites/admin/api/handlers.py", line 353, in get\n', ' File "//usr/local/www/sites/admin/api/handlers.py", line 399, in web_api_get\n', ' File "//usr/local/www/sites/admin/api/handlers.py", line 368, in process_method\n', "TypeError: 'NoneType' object has no attribute '__getitem__'\n"]

Ошибка функции web_api_get говорит о том, что скорей всего проблема в выполняемых к биллингу API-запросах. Отладить это можно по статье API REST v2.0, раздел "Отладка"

Нужно добавить префикс для логинов в настройках услуги!

2019-09-12 08:35:17,269 - django - commands - ERROR - Логин {0} состоит из одних цифр и может быть не принят!

2019-09-12 08:35:17,269 - django - commands - ERROR - Нужно добавить префикс для логинов в настройках услуги!

Ошибка говорит о том, что в услуге создающей учетную запись не задан префикс. Вероятней всего ошибка возникла при настройке услуг IPTV

Посмотреть список услуг создающих учетные записи и из префиксы можно через конструктор отчетов таким запросом:

select id, name ,create_login, prefix_login from usluga where create_login=1

Сервер вернул ошибку: requirement failed: Service ID must be non-empty

2019-12-09 00:01:47,894 - django - commands - ERROR - Сервер вернул ошибку: requirement failed: Service ID must be non-empty

Проблема может возникнуть при интеграции Megogo, если:

- В какой-то из услуг с пакетами ТВ не указан параметр "Строка с дополнительными параметрами по активации"

- В какой-то из услуг с пакетами ТВ не указан параметр "Строка с дополнительными параметрами по деактивации"

- Подключена услуга создающая учетную запись и в ней тоже нет одного из указанных параметров

Посмотреть списки услуг создающих учетные записи и из префиксы можно через конструктор отчетов такими запросами:

select u.id,u.name from usluga u join nas n on u.nas_id=n.id join nas_scheme ns on n.nas_scheme_id=ns.id and ns.object_type_id=2 where u.deleted=0 and (u.activate_string='' or u.deactivate_string='') and u.create_login=0

select u.id,u.name from usluga u join nas n on u.nas_id=n.id join nas_scheme ns on n.nas_scheme_id=ns.id and ns.object_type_id=2 where u.create_login=1 and ns.name='Megogo'

У абонента не настроен email

2019-12-13 15:00:54,690 - django - commands - ERROR - У абонента не настроен email 2019-12-13 15:01:04,435 - django - commands - ERROR - У абонента не настроен email 2019-12-13 15:01:06,266 - django - commands - ERROR - У абонента не настроен email

Ошибка может возникнуть при интеграции с сервисами IPTV, если абоненту подключили услугу, но у него нет адреса почты - как правило такие сервисы регистрируют абонента по адресу почты и/или номеру телефона.

В частности, адрес почты обязателен при интеграции со Смотрёшкой.

Для решения проблемы выполните этот отчет в конструкторе и заполните у абонентов адреса почты, или отлючите у них услуги ТВ.

select distinct a.contract_number,a.name from abonents a join users_usluga uu on a.id=uu.abonent_id join usluga u on uu.usluga_id=u.id join nas n on u.nas_id=n.id join nas_scheme ns on n.nas_scheme_id=ns.id and ns.object_type_id=2 where u.deleted=0 and uu.deleted=0 and a.deleted=0 and (a.email='' or a.email is null)

Сервис IPTV недоступен (ERROR - Произошла ошибка)

В логе на котрый ссылается тест написано что просто произошла ошибка:

2019-12-16 05:39:40,098 - worker - lifestream_sync - ERROR - Произошла ошибка

Если посмотреть полный лок синхронизатора, можно увидеть на каком этапе скрипт синхронизации завершился, информация об этом есть в следующих строках:

2019-12-16 05:29:39,911 - worker - lifestream_sync - ERROR - Произошла ошибка Traceback (most recent call last): File "/mnt/var/oss/core/LifeStream/init.d/lifestream_sync", line 162, in <module> iptv_portal.compare_users() File "/mnt/var/oss/core/LifeStream/init.d/lifestream_sync", line 53, in compare_users self.logger.info(u'Пользователей на портале: {0}'.format(len(self.remote_abonent_list['accounts']))) File "/mnt/var/oss/core/LifeStream/lib/lifestream_package/commands.py", line 177, in remote_abonent_list self._remote_abonent_list = self.get_remote_abonent_list() File "/mnt/var/oss/core/LifeStream/lib/lifestream_package/commands.py", line 168, in get_remote_abonent_list urlpath='accounts?page_size={0}&page={1}'.format(50000, 0) File "/mnt/var/oss/core/LifeStream/lib/lifestream_package/commands.py", line 92, in response_wrapper -- return session.request(method=method, url=url, **kwargs) File "/usr/lib/python2.7/site-packages/requests/sessions.py", line 468, in request resp = self.send(prep, **send_kwargs) File "/usr/lib/python2.7/site-packages/raven/breadcrumbs.py", line 297, in send resp = real_send(self, request, *args, **kwargs) File "/usr/lib/python2.7/site-packages/requests/sessions.py", line 576, in send r = adapter.send(request, **kwargs) File "/usr/lib/python2.7/site-packages/requests/adapters.py", line 437, in send raise ConnectionError(e, request=request) ConnectionError: HTTPSConnectionPool(host='https', port=443): Max retries exceeded with url: //bestisp.proxy.lfstrm.tv/v2/accounts?page_size=50000&page=0 (Caused by NewConnectionError('<requests.packages.urllib3.connection.VerifiedHTTPSConnection object at 0x7f8bee64a750>: Failed to establish a new connection: [Errno -2] Name or service not known',))

По тексту ошибки видно, что сервис телевидения недоступен, это можно понять по фразам "ConnectionError" и "Max retries exceeded with url".

Возможные причины:

- Проблема с DNS: внутри контейнера биллинга он указан неправильно или не указан. Для этого проверьте домен Вашего порта командой nslookup, например:

chroot /app/asr_billing/ nslookup bestisp.proxy.lfstrm.tv

Указать правильный DNS можно по статье "Настройки сети"

- Проблема с DNS: либо сервер возвращате неверный IP. Для решения проблемы обратитесь к администратору используемого DNS-сервера или используйте другой сервер.

- Иные сетевые проблемы: например, если с DNS все в порядке, но сервис недоступен по сети, не вингуется, не отвечает на запросы и тд. Решение этой проблемы ни чем не отличается от решения любой другйо сетевой проблемы и не относится к настройке биллинга и данной документации.

Не удалось синхронизировать тех. группу: Ошибка при проверке номера

2020-01-15 08:08:14,658 - django - authBackend - CRITICAL - Не удалось синхронизировать тех. группу: Ошибка при проверке номера: (0) Could not interpret numbers after plus-sign.

Ошибка говорит о том, что в настройках пользователей биллинга некорректно указан номер смс для оповещения. Номер телефона должен удовлетворять формату E.164:+79123456789 или 89123456789.

Ошибка ввода значения в форму.

2021-05-25 16:30:00,581 - django - widgets - ERROR - Value 'Новый абонент' is not a valid choice. 2021-05-25 16:34:45,919 - django - widgets - ERROR - Value 'Новый абонент' is not a valid choice.

Сообщение "not a valid choice" обычно говорит о том, что в какую-то из форм ввели неверное значение.

Ошибка обработки запроса.

Выдержка из лога сделанная тестом пишет о том что возникла ошибка обработки запроса: речь о запросе фреймворка Django, на котором разработано ядро биллинга, к базе данных.

2020-09-09 08:40:19,347 - django - __init__ - ERROR - Ошибка обработки запроса 2020-09-09 08:46:44,690 - django - __init__ - ERROR - Ошибка обработки запроса

Если посмотреть полный лог, можно будет увидеть детали ошибка типа "Traceback" и сам запрос, например:

2020-09-09 11:29:11,993 - django - __init__ - ERROR - Ошибка обработки запроса Traceback (most recent call last): File "/usr/lib/python2.7/site-packages/django/core/handlers/base.py", line 137, in get_response ... "Error while preparing SQL statement:") DatabaseError: ('Error while preparing SQL statement:\n- SQLCODE: -206\n- Dynamic SQL Error\n- SQL error code = -206\n- Column unknown\n- USLUGA.USLUGA_VOIP_GROUP_ID ...

Решение

- Если версия уже актуальная, возможно обновление прошло не полностью. В первую очередь попробуйте обновить базу принудительно:

/app/asr_billing/service stop chroot /app/asr_billing update_hook.sh --force exit /app/asr_billing/service start

- Обновите биллинг до актуальной версии.

- Если версия уже актуальная, запустите принудительное обновление - возможно повреждён какой-то файл или во время обновления произошла ошибка и новая версия не загрузилась:

carbon_update --force

- Если все предыдущие действия не помогли - напишите разработчикам, приложив к задаче файл /app/asr_billing//var/log/django/error.log

check_error_voip_radius.sh:

- check_error_voip_radius.sh: ERROR(2) [FAILED]

ALARM обнаружены ошибки в работе радиус сервера VOIP

За последний час ERROR: 270

Лог службы /var/log/radius_asterisk/radius_debug.log

Подробности в логе /app/asr_billing/var/monitoring_dump/check_error_voip_radius.sh_28358.log

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-checkerrorradiusvoip.sh

Ошибка возникает если в логе RADIUS-сервера телефонии обнаружены ошибки обработки звонков.

Посмотреть найденные ошибки можно в логе из описания заявки, в приведенном выше примере это check_error_voip_radius.sh_28358.log

Для диагностики включите опцию "Включить DEBUG для Radius демона телефонии" в настройках биллинга и попробуйте совершить тестовый звонок.

Если звонок не проходит или в не появляется в расходе абонента по завершению, посмотре лог ошибок, возможные причины:

- Выбрана неправильная OSS схема

- Присылаемые NAS-сервером атрибуты не учтены в схеме

- Так же вероятная причина - не все требуемые атрибуты схемы приходят от оборудования, например:

2019-06-25 15:17:03 ++[python_error <140078326261696>] File "/usr/lib/python2.7/site-packages/radius_python/billing_tools/radius.py", line 171, in make_correct_acc_record new_env['NAS-Port'] = env['NAS-Port'] 2019-06-25 15:17:03 ++[python_error <140078326261696>]KeyError: 'NAS-Port'

Если исправить проблемы второго и третьего случаев невозможно решить настройкой оборудорвания (например, словарь атрибутов или из формат не настраиваются), потребуется доработать OSS схему или создать новую. С таким запросом Вы можете создать обращение на портале HelpDesk.

check_critical_pumper.sh

- check_critical_pumper.sh

ALARM Ошибки в работе архиватора БД

За последний час обнаружено CRITICAL ошибок: 6

Тест регистрирует наличие некритичных ошибок обработчика, который переносит старые данные в архивную БД.

Узнать, что за ошибки произошли, Вы можете следующей командой:

grep ERR /app/asr_billing/var/log/pumper_daemon.log

check_error_paysystems.sh

- check_error_paysystems.sh: ERROR(2) [СБОЙ ]

WARNING платежи или чеки клиентов не обработаны

Необходимо проверить ошибки и устранить.

За последний час CRITICAL: 436

За последний час ERROR: 0

Лог службы /app/asr_billing//var/log/paysystemsd.log

Подробности в логе /app/asr_billing/var/monitoring_dump/check_error_paysystems.sh_11674.log

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-checkerrorpaysystems.sh

Тест говорит о наличии ошибок синхронизации с сервисам АТОЛ Онлайн.

Просмотреть чек по которому произошла ошибка можно следующим образом:

- Найдите ошибку в логе службы обработки платежей:

/app/asr_billing/mnt/log/paysystemsd.log

- Пример ошибки:

2019-10-03 03:51:03,015 - worker - paysystems_lib - INFO - Обрабатываем чек 1111111d-0acf-4cfd-ac16-e0215b098cf2 storno=False #13858 2019-10-03 03:51:03,402 - worker - paysystems_lib - ERROR - ERROR: Ошибка АТОЛ-Онлайн: [-3897] Не удалось выполнить операцию закрытия документа. Ответ от ККТ: [-3897] Описание: Чек оплачен не полностью. (id -no id-)

- Откройте чек в вэб интерфейсе биллинга. Здесь 1111111d-0acf-4cfd-ac16-e0215b098cf2 – идентификатор действия со стороны атол-онлайн, #13858 – номер финансовой операции в биллинге. Укажите его в ссылке на акт (Абонент->Операции->Операция->иконка с принтером):

http://<ip-биллинга>:8082/admin/FinanceOperations/print/13858/

ATOL ошибка сервера

- Пример ошибки:

2021-02-21 12:05:40,512 - worker - paysystems_lib - ERROR - ERROR: ATOL ошибка сервера: [2001] При регистрации чека свободная касса в группе не появилась за опредённый в конфигурации диапазон времени (по умолчанию, 5 минут). (id -no id-); id операции=00001 id абонента=1001

- Ошибка говорит об отсутствии связи с сервисом АТОЛ Онлайн. Обратитесь в техническую поддержку АТОЛ.

Не обработано чеков платежей: N из-за отсутствия email или sms!

2019-10-17 12:08:00,311 - worker - paysystems_lib - CRITICAL - не обработано чеков платежей: 10 из-за отсутствия email или sms!

В данном случае ошибка возникла из-за того что в карточке абонента не заведены "Email для оповещений" или "Номер SMS для оповещений".

Для решение проблемы требуется:

1. Проверить наличие E-Mail чека по умолчанию в настройках "АТОЛ Онлайн"

2. Проверить в /app/asr_fiscal/cfg/config опцию atol_online 'cabinet' на наличие параметра 'default_email'

Например:

atol_online['cabinet']='enable login passwd kkt_group inn mesto email sno vat'

Исправить на:

atol_online['cabinet']='enable default_email login passwd kkt_group inn mesto email sno vat'

Для ускорения применения настроек требуется выполнить следующую операцию:

chroot /app/asr_billing/ python /usr/local/bin/get_fiscal_config.py

check_error_worker.sh

- check_error_worker.sh: ERROR(2) [СБОЙ ]

ALARM Имеются ошибки в логе worker за последний час: 57

2019-02-22 08:38:32: pl5monitoring ALARM Имеются ошибки в логе worker за последний час: 57

Тест регистрирует наличине некритичных ошибок обработки абонентов, но требующих реакции администратора.

Узнать что за ошибки произошли Вы можете следующей командой:

grep ERR /app/asr_billing/var/log/worker.log

Более подробная статья Worker(ядро биллинга).

Описание возможных ошибок ядра биллинга.

account_traf - Не найден абонент для N записей (некорректная настройка Collector)

2019-02-22 08:38:02,458 - worker - account_traf - ERROR - Не найден абонент для 367 записей

Ошибка говорит о том, что обработчик абонентов не смог соотнести с каким-либо абонетом часть данных пришедших от коллектора аккаунтинга интернет-трафика

Это может произойти, если список с учетными записями и их IP-адресами на стороне коллектора устарел, вероятней всего по какой-то причине он не смог его синхронизировать (синхронизация проходит каждые 30 секунд).

В первую очередь стоит посмотреть лог синхронизатора:

# egrep -i 'CRIT|ERR' /app/collector/var/log/sync_billing.log | head -n 2 2019-02-08 03:48:50,602 - CRITICAL - Не удалось выполнить api запрос: http://192.168.8.71:8082/system_api/?arg1=%7B%7D&model=Collector&psw=3ln8bshn&context=collector&method1=collector_manager.collector_get_checked_ip_pools&format=json. Error: <urlopen error [Errno 101] Network is unreachable>

Список не обновился потому что в настройках коллектора указан неверный IP-адрес биллинга:

# grep api_ip /app/collector/cfg/config collector['api_ip.widget']='inputbox "IP адрес для доступа к API биллинга" "IP адрес для доступа к API биллинга"' collector['api_ip']='192.168.8.71'

Так как коллектор и биллинг находятся на одном физическом сервере, просто в разных контейнерах, в настройках следует указывать локальный адрес биллинга 169.254.80.82. Приведите параметр к следуещему виду:

collector['api_ip']='169.254.80.82'

И перезапустите коллектор:

/app/collector/service restart

account_traf - Не найден абонент для N записей (аккаунтинг по неизвестным биллингу IP-адресам)

2019-02-26 09:00:51,620 - worker - account_traf - ERROR - Bad traffic row ID=3408858 IP=10.24.240.1 2019-02-26 09:00:51,621 - worker - account_traf - ERROR - Bad traffic row ID=3408857 IP=10.24.240.1 2019-02-26 09:05:48,390 - worker - account_traf - ERROR - Не найден абонент для 4 записей 2019-02-26 09:05:48,392 - worker - account_traf - ERROR - Bad traffic row ID=3409307 IP=172.31.10.2 2019-02-26 09:05:48,392 - worker - account_traf - ERROR - Bad traffic row ID=3409350 IP=192.168.0.110 2019-02-26 09:05:48,393 - worker - account_traf - ERROR - Bad traffic row ID=3409361 IP=172.31.10.1 2019-02-26 09:05:48,393 - worker - account_traf - ERROR - Bad traffic row ID=3409306 IP=172.31.10.2 2019-02-26 09:15:40,475 - worker - account_traf - ERROR - Не найден абонент для 2 записей 2019-02-26 09:15:40,477 - worker - account_traf - ERROR - Bad traffic row ID=3410341 IP=192.168.0.100 2019-02-26 09:15:40,477 - worker - account_traf - ERROR - Bad traffic row ID=3410342 IP=192.168.0.100

В случае если у Вас возникает ошибка аккаунтинга интернет-трафика, при этом в логе Вы видите записи "Bad traffic row", но нет ошибки синхронизации Collector, как в выше приведенном кейсе, вероятней всего проблема в том, что аккаунтинг (netflow) приходит по IP-адресам находящимся в Вашей сети, но не заведенным в биллинг.

Для решения проблемы ограничте набор интерфейсов с которых собирается netflow и разместите хосты вызывающие ошибку за другими интерфейсами BRAS. В случае если это сделать не возможно, например если Ваше оборудование не имеет такой настройки netflow-сенсора или это нарушит структуру сети, назначьте данные адреса учетным записям в биллинге, Вы можете использовать для этого одного абонента назвав его "Служебный трафик" или завести для каждого хоста своего абонента.

Получить список адресов вызывающих ошибку Вы можете следующей командой:

grep 'Bad traffic row ID' /app/asr_billing/var/log/worker.log | awk '{print $14}' | sed 's/IP=//g' | sort | uniq

Примерный результат:

10.24.240.1 172.16.5.148 172.31.10.1 172.31.10.2

account_traf - Неизвестный трафик (NAS не опознал трафик)

2020-04-27 03:35:19,771 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 04:05:12,614 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 04:35:22,370 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 05:05:11,747 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 05:35:21,180 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 06:05:11,770 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 06:35:11,355 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 07:05:14,855 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик) 2020-04-27 07:35:08,466 - worker - account_traf - WARNING - Неизвестный трафик: user_id=-1, user_ip=0 (NAS не опознал трафик)

В данном случае NAS не смог распознать трафик и прислал трафик с IP адресом 0.0.0.0 Для начала убедимся, что действительно в collector приходит netflow поток с неверным IP адресом в содержимым:

- Включим повышенное логирование в контейнере collector:

mkdir -p /app/collector/cfg/etc/netflow_collector/ cp -p /app/collector/etc/netflow_collector/nf_collector.conf /app/collector/cfg/etc/netflow_collector/nf_collector.conf sed 's|LOG_LEVEL=0|LOG_LEVEL=3|' -i /app/collector/cfg/etc/netflow_collector/nf_collector.conf /app/collector/service restart

- Подождём 5 минут, чтобы накопились данные в логе.

- Проверим какие IP адреса не смог распознать collector. Мы видим в первой записи адрес 0.0.0.0

grep 'New entry for ip' /app/collector/var/log/nf_collector.log | awk '{print $12}' | sort -u | head -n 3 0.0.0.0 10.0.0.20 10.100.20.20

- Выключим расширенное логирование collector

rm -f /app/collector/cfg/etc/netflow_collector/nf_collector.conf /app/collector/service restart

Теперь мы убедились, что в netflow потоке приходит IP адрес 0.0.0.0 Для исправления проблемы вам нужно настроить поток netflow на NAS, для этого обратитесь к официальной документации по своему NAS.

account_voip - Проблема с межоператорским расчетом звонка VoipLog

2019-04-04 16:27:42,794 - worker - account_voip - ERROR - Проблема с межоператорским расчетом звонка VoipLog [ id=805042, src=71111111111, dst=72222222222, s_time=2019-04-04 16:26:30, suid=CDR_SMG1016201904041626305842335, dst_chan=Provider2 ] Доступные операторы: Abonents [ id=1418, name=ООО "Лучший провайдер" ]

Решение проблемы описано в статье "FAQ по ошибкам телефонии"

account_voip - Вы используете deprecated настройки для парсера CDR / Для OSS схемы 250002 не настроен обработчик CDR

2020-04-20 08:44:41,544 - worker - account_voip - WARNING - Вы используете deprecated настройки для парсера CDR. 2020-04-20 08:44:41,544 - worker - account_voip - ERROR - Для OSS схемы 250002 не настроен обработчик CDR

Данная ошибка проявляется, когда в биллинге создан VOIP NAS, но не инициализирован и отсутствуют правила обработки CDR-файлов. Для решения проблемы, необходимо выполнить настройку по инструкции: "Настройка парсинга CDR":

- Инициализируйте NAS

- Добавьте настройки CDR-парсера из статьи

account_traf - Очень старая дата у трафика!

2019-08-28 12:41:40,184 - worker - account_traf - ERROR - Очень старая дата у трафика! Проверьте настройки NAS! Дата: 2010-10-24 02:43:35, User ID: 4769, NAS: 10.0.0.1

Проблема вызвана тем, что в потоке netflow дата и время трафика отличаются от установленных на биллинге. В сообщении об ошибки можно увидеть дату которая была в netflow, ID учетной записи и IP NAS-сервера.

| Чтобы посмотреть по какой учетной записи возникла проблема в интерфейсе биллинга, подставьте ID из ошибки в адресную строку. Пример. Допусти Вы подключаетесь к биллингу по IP 192.168.0.10, ссылка на учетную запись ID 4769 будет такой: http://192.168.0.10/admin/Users/4769 |

Настройка netflow-потоков подробно описана в статье. Для того, что бы решить проблему выполните:

- Установите утилиту tshark;

yum -y install wireshark

- Запустите захват пакетов. В примере произведён захват по стандартному порту netflow 9996, на всех интерфейсах;

tshark -pni any port 9996 -V -c 3 | grep -C 1 Timestamp

Вывод будет выглядеть следующим образом:

tshark -pni any port 9996 -V -c 3 | grep -C 1 Timestamp Running as user "root" and group "root". This could be dangerous. Capturing on Pseudo-device that captures on all interfaces SysUptime: 1968550053 Timestamp: May 29, 2019 14:03:54.000000000 IRKT CurrentSecs: 1559109834 -- SysUptime: 1968550053 Timestamp: May 29, 2019 14:03:54.000000000 IRKT CurrentSecs: 1559109834 -- SysUptime: 1968550053 Timestamp: May 29, 2019 14:03:54.000000000 IRKT CurrentSecs: 1559109834 3 packets captured

Нас интересует значение поля Timestamp.

- Посмотрите дату и время установленные на биллинге:

date

Видим, что время отличается на два часа:

date Срд Май 29 16:05:03 IRKT 2019

- Измените дату и время на NAS исходя из полученных данных.

usluga_abon_pay - У абонента услуга из другого тарифа!

2019-11-16 04:31:35,160 - worker - usluga_abon_pay - ERROR - У абонента #25262 услуга #51323 из другого тарифа! 2019-11-16 04:31:35,195 - worker - usluga_abon_pay - ERROR - У абонента #25306 услуга #51779 из другого тарифа! 2019-11-16 04:31:35,205 - worker - usluga_abon_pay - ERROR - У абонента #25429 услуга #54374 из другого тарифа! 2019-11-16 04:31:35,230 - worker - usluga_abon_pay - ERROR - У абонента #25447 услуга #54821 из другого тарифа! 2019-11-16 04:31:35,240 - worker - usluga_abon_pay - ERROR - У абонента #25457 услуга #55231 из другого тарифа!

Это исключительная ситуация и причину можно попробовать найти в аудите, исходя из даты когда последний раз меняли тариф: возможно в этот момент произошла ошибка транзакции.

Для исправления проблемы:

- Переключите абонента на временный тариф, потом верните нужный

- При необходимости сделайте абоненту перерасчет начиная с нужной даты

#25262 - это id абонета в базе данных. Быстро перейти на него в веб интерфейсе можно по ссылке:

http://<ip-биллинга>:8082/admin/Abonents/25262

|

csv_loading - Файл конфигурации пустой

2020-07-08 06:04:08,979 - worker - csv_loading - ERROR - Файл конфигурации /cfg/autocsv/test.autocsv пустой 2020-07-08 06:04:40,464 - worker - csv_loading - ERROR - Файл конфигурации /cfg/autocsv/test.autocsv пустой 2020-07-08 06:04:41,633 - worker - csv_loading - ERROR - Файл конфигурации /cfg/autocsv/test.autocsv пустой 2020-07-08 06:04:42,432 - worker - csv_loading - ERROR - Файл конфигурации /cfg/autocsv/test.autocsv пустой 2020-07-08 06:05:10,670 - worker - csv_loading - ERROR - Файл конфигурации /cfg/autocsv/test.autocsv пустой

В каталоге с настройками для выгрузки платежей из CSV находистся пустой файл настройки. Видимо вы создали файл для настроек выгрузки платежей и не заполнили его. Пустой файл нужно удалить:

- Посмотрим содержимое каталога:

ls -l /app/asr_billing/cfg/autocsv/

Видим два файла с настройками, test.autocsv - пустой.

-rw-rw-rw- 1 root root 0 Июн 16 11:28 test.autocsv -rwxrwxrwx 1 root root 769 Июн 29 1976 default.autocsv - Удалмите пустой файл:

rm -f /app/asr_billing/cfg/autocsv/test.autocsv

csv_loading - codec can't decode byte

2021-03-16 12:05:14,927 - worker - csv_loading - ERROR - Ошибка при обработке выгрузки csv: file_name=/var/autocsv/default/test.csv 2021-03-16 12:05:14,927 - worker - csv_loading - ERROR - 'utf8' codec can't decode byte 0xe2 in position 3: invalid continuation byte

Кодировка CSV файла с платежами отличается от указанной настройках загрузки платежей из CSV.

Проверить различе кодироваок можно командами:

- Определите к какой платёжной системе относится файл:

Пример файла

/var/autocsv/default/test.csv

Файл загружен в каталог default. Определим в каком конфигурационнм файле он используется:

fgrep default /app/asr_billing/cfg/autocsv/* /app/asr_billing/cfg/autocsv/test.autocsv:csv_path: '/var/autocsv/default/'

Видино что каталог default задан в конфигурационном файле:

/app/asr_billing/cfg/autocsv/test.autocsv

- Посмотрите какая одировка в конфигурацинном файле:

Кодировка в конфигурационном файле

grep encoding /app/asr_billing/cfg/autocsv/test.autocsv encoding: 'windows-1251'

- Сравните её с файлом, который вы загрузили на сервер:

Кодировка файла с платежами

file --brief --mime-encoding /app/asr_billing/var/autocsv/default/test.csv utf-8

- Исправьте конфигурационный файл по статье.

Ошибка обработки отправки отложенных комманд ConnectionTimeout

2020-06-26 10:09:05,928 - worker - common - CRITICAL - Ошибка обработки отправки отложенных комманд ConnectionTimeout caused by - ReadTimeoutError(HTTPConnectionPool(host='169.254.92.94', port=9200): Read timed out. (read timeout=30))

При фиксировании данной ошибке в логе worker необходимо перезапустить службу elasticsearch

chroot /app/asr_billing/ service elasticsearch restart

Если перезапуск не устранил ошибку, тогда необходимо выполнить переиндексацию базы биллинга по инструкции

Поле логин не должно содержать символы пробела!

2021-02-04 18:05:07,934 - worker - common - ERROR - Ошибка обработки статуса услуг: Поле логин не должно содержать символы пробела!

Ошибка возникает, если учетная запись была создана для абонента, номер договора которого содержит символ пробела. Получить список таких абонентов можно командой:

sqlexec "set list; select name, contract_number from abonents where contract_number like '% %'"

NAME Александров В. А.

CONTRACT_NUMBER BILL0000025

Для решения проблемы необходимо убрать пробелы из номера договора по статье Изменение номера договора

Не могу выставить акт - абонент не главный на л.с.

2021-10-10 15:04:09,693 - worker - balance_change - ERROR - Не могу выставить акт - абонент не главный на л.с.: [4071]Абонент 1 account_id=10002908 master=None main=False 2021-10-10 15:04:09,701 - worker - balance_change - ERROR - Не могу выставить акт - абонент не главный на л.с.: [4159]Абонент 2 account_id=10002908 master=None main=False

Ошибка сообщает о том, что в биллинге, на одном лицевом счете 10002908 назначены две записи абонентов и не включена опция "Главный абонент", в результате, биллинг не может корректно выставить акты по лицевому счету, что может привести к нарушению блокировки абонентов по балансу. Подробная информация по настройке абонентов с одним лицевым счетом обозначена в документации.

test_httpd.sh

- test_httpd.sh: ERROR(2) [FAILED]

ALARM Недоступен веб-интерфейс биллинга

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-testhttpd.sh

Stopping Admin Web Server: Starting Admin Web Server: [ OK ]

Stopping nginx: [FAILED]

Starting nginx: [ OK ]

Исправить проблему автоматически не удалось.

Тест говорит о том, что веб-интерфейс управления абонентами и тарифами недоступен.

Найти ошибку можно попытаться в следующих логах веб-сервера:

/app/asr_billing/var/log/nginx/error.log /app/asr_billing/var/log/nginx/access.log /app/asr_billing/var/log/admin_web_server.log /app/asr_billing/var/log/wget_abonents.log

По-умолчанию веб-сервер использует порты 8082 (http) и 8382 (https).

Убедитесь, что в конфигурационном файле /app/asr_billing/cfg/config заданы сделующие параметры:

app['apache.port']='8082' app['apache.ip']='169.254.80.82' app['apache.sslport']='8382' app['apache.sslip']='169.254.83.82'

check_interbase_log.sh

Тест проверяет журнал ошибок работы СУБД:

- check_interbase_log.sh: ERROR(2) [FAILED]

ALARM Обнаружены ошибки в логах Firebird

Необходимо проверить лог /app/asr_billing//var/log/firebird/firebird.log.catched.1559807284

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-checkinterbaselog.sh

В выводе теста написан путь до журнала обнаруженных ошибок: /app/asr_billing//var/log/firebird/firebird.log.catched.1559807284

Вы можете посмотреть его командой cat:

cat /app/asr_billing//var/log/firebird/firebird.log.catched.1559807284

Примре вывода:

localhost.localdomain Thu Jun 6 12:31:16 2019 I/O error for file "/usr/lib64/firebird/security2.fdb" localhost.localdomain Thu Jun 6 12:31:16 2019 Error while trying to open file localhost.localdomain Thu Jun 6 12:31:16 2019 No such file or directory localhost.localdomain Thu Jun 6 12:31:16 2019 I/O error for file "/usr/lib64/firebird/security2.fdb" localhost.localdomain Thu Jun 6 12:31:16 2019 Error while trying to open file localhost.localdomain Thu Jun 6 12:31:16 2019 No such file or directory

В данном случае ошибка связана с доступом к файлу одной из системных баз, обеспечивающих работу СУБД.

Как правило, такие задачи следует передавать в отдел разработки для детального анализа каждого конкретного случая.

Тем не менее, это не всегда обязательно.

Есть несколько случаев, которые можно проверить и устранить самостоятельно:

- В первую очередь следует проверить общий системный лог /var/log/messages на наличие ошибок дисковой подсистемы, если они есть и относятся к диску на котором расположена БД биллинга - это с высокой долей вероятности может вызвать ошибку работы СУБД.

- Далее можно попробовать посмотреть содержимое файла /app/asr_billing//var/log/firebird/xinetd_169.254.30.50.log, это журнал службы управляющей соединениями сервера баз данных, он необходим для экономии ресурсов системы и поддержания нагрузки на БД в разумных пределах.

Если количество обращений к БД превышает допустимое, это вызовет отказ в соединении и в логе СУБД firebird.log появятся соответствующие записи.

В таком случае попробуйте временно ограничить объём внешних соединений к серверу - обращения по API, доступ в панель управления абонентами и тарифами, количество одновременно выполняемых отчетов в конструкторе

test_free_space.sh

- test_free_space.sh: ERROR(2) [FAILED]

ALARM Заканчивается свободное место на диске

check_db_space /var/db/billing.gdb size is 3006791680 and on /var/db used 89%; TRIPLE_BILLING_DB_SIZE=12027166720; FREE_SPACE=10921476096; Filesystem 1K-blocks Used Available Use% Mounted on

- 100660656 27950292 67590364 30% /mnt/backup

- 100660656 84875152 10665504 89% /mnt/db

- 3966144 54912 3706432 2% /mnt/etc

- 100660656 25254224 70286432 27% /mnt/log

- 9948012 6783132 2652880 72% /mnt/shared

- 3497752448 2580575136 739494984 78% /mnt/var

Тест test_free_space.sh проверяет что на разделе /var/db (/mnt/db в хост системе) свободного места в четыре раза больше текущего размера БД биллинга. Объём в четыре размера БД необходим для верной работы скриптов резервного копирования и автоматического восстановления после сбоев.

В первую очередь проверьте следующие папки:

- /mnt/db/app/asr_billing/db/notstopped - базы, поврежденные в результатате некорректного завершения работы сервера.

- /mnt/db/app/asr_billing/db/safemode - рабочиие базы, работа которых была завершена корректно, их можно восстановить в работу.

- /mnt/db/app/asr_billing/db/replaced_by_shadow - поврежденные базы, замененные теневой копией

- /mnt/db/app/asr_billing/db/buff_traf.gdb.ГГГГММ - базы с аккаунтингом трафика

Базы из папок notstopped и replaced_by_shadow могут пригодится если Вы планируете проводить детальный анализ поврежденных баз. Если нет - их можно очистить.

Базы из папки safemode можно очистить только в том случае, если в настоящий момент биллинг находится в работе.

Базы buff_traf.gdb.ГГГГММ (например, buff_traf.gdb.201904) содержат информацию по объёмам трафика полученную из netflow или radius accounting, данные из них агрегируются и добавляются в основную БД billing.gdb, их можно видеть в карточках абонентов на вкладке "Расход". Их можно удалять.

test_radius_nas_list.sh

- test_radius_nas_list.sh: ERROR(1) [СБОЙ ]

Nas с IP 192.168.0.1 нету в /etc/raddb/clients.conf

2017-03-21 14:48:52 localhost test_radius_nas_list.sh[1277]: Fix radiusd by restart

Останавливается radiusd: [ OK ]

Останавливается radiusd_acc: [ OK ]

Запускается radiusd: [ OK ]

Запускается radiusd_acc: [ OK ]

Nas с IP 192.168.0.1 нету в /etc/raddb/clients.conf

Тест пытается исправить ошибку автоматически, пересоздав конфигурационные файлы radius.

Такое может произойти, в следующих случаях:

- при обновлении, в случае если radius-сервер запустился раньше чем закончилась перезагрузка СУБД по той или иной причине

- если Вы не указали ни OSS-схему ни Тип НАСа при добавлении (например, если добавляли NAS не мастером, или не удалили демонстрационные NAS).

Также данный тест может сообщать следующую ошибку:

ALARM список разрешенного оборудования в Radius не совпадает со списком базы

В тесте есть скрипт, проверяющий соответствие NAS в БД и конфигурационном файле /app/asr_billing/etc/raddb/clients.conf. В случае, если в момент тестирования наблюдались сбои при обращении к БД, может появиться эта ошибка.

Найти причину можно попробовать в логе RADIUS или его архивных копиях:

/app/asr_billing/var/log/radius/radius.log /app/asr_billing/var/log/radius/radius.log-20191104.gz

Первый файл - актуальный лог

Второй - архивны, в нем информация от момета предыдущей архивации до 04 ноября 2019 года.

Чтобы найти причину, ориентируйтесь на время написанное при падении теста - в примере выше это "2017-03-21 14:48:52". Изучив лог за это время можно найти более подробную информацию о причине ошибки, вероятно она одна из описанных выше.

Если проблема повторяется часто, составьте обращение в портале HelpDesk.

test_radius.py

Для отладки теста и подробного разбора проблемы можно выполнить его в режиме повышенного логирования

chroot /app/asr_billing python2.7 /usr/local/angel/test_radius.py --debug

check_billing_radius_acc_netstat.sh

Для решения проблемы попробуйте перезапустить обработчик аккаунтинга RADIUS:

chroot /app/asr_billing/ service radiusd_acc restart

Если проблема сохраняется, составьте обращение в портале HelpDesk.

test_daemons.sh

Тест срабатывает если одна из служб контейнера не работает и пытается исправить ситуацию автоматический (перезапуском службы). В любом случае будет создана автоматическая заявка. Пример текста ошибки:

- test_daemons.sh: ERROR(2) [FAILED]

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_daemon admin_web_server

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: - check_pidfile admin_web_server ok

...

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_daemon radiusd_acc

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: - check_pidfile radiusd_acc ok

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_daemon radiusd_traf

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_pidfile - Pidfile not found for radiusd_traf

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: radiusd_traf restart

Stopping radiusd_traf: [FAILED]

Starting radiusd_traf: [ OK ]

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_daemon radiusd_traf

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: check_pidfile - Pidfile not found for radiusd_traf

...

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: - check_pidfile xinetd ok

2019-03-29 14:29:53 billing,megatc_ru test_daemons.sh[26103]: ALARM Некоторые демоны не работают, проверьте тест test_daemons.sh

При запуске все службы (=демоны) asr_billing создают маркерный файл в директории /var/lock/subsys/, так тест понимает какие службы нужно проверять (это нужно на случай если какие-то из них отключены в конфигурационном файле контейнера).

По каждой службе из полученного списка тест ищет pid-файл и проверяет что процесс запущен. В результате проверки он может вернуть либо состояние "ОК", что значит что проверка пройдена успешно, либо одну из следующимх ошибок:

- Pidfile not found - тест не нашел пути pid-файл для процесса

- No pidfile - по найденому пути либо не pid-файл (например, папка), либо он удален

- No pid - в PID-файле не оказалось ID процесса (например, если файл оказался пустым)

- No proc entry - pid-файл найден, но процесса с указанным ID не оказалось.

Pidfile not found

Ошибка может произойти если при запуске службы возникли ошибки и запуск не был корректно завершен.

Еще одной возможной причиной может быть если почему-то пропал PID-файл, при том что сама служба работает.

Например, перезапустим службу аккаунтинга трафика:

# /etc/init.d/radiusd_traf restart Stopping radiusd_traf: [FAILED] Starting radiusd_traf: [ OK ]

Ошибка произошла про причине того, что процесс уже запущен, но PID-файл почему-то не создан:

# ps aux | grep radiusd_traf | grep -v grep radiusd 10218 0.0 0.0 492948 4516 ? Ssl 03:30 0:00 /usr/sbin/radiusd_traf -d /etc/raddb_traf

Находим должное насположение PID-файла (подставьте путь до init файла службы) и убеждаемся что его действительно нет и ошибка не в самом тесте:

# grep ^prog /etc/init.d/radiusd_traf | sed 's/.*=//g' | while read progname; do pidpath=$(grep ^pidfile /etc/init.d/radiusd_traf | sed 's/\$prog/'$progname'/g; s/.*=//g; s/\}//g'); ls -l $pidpath; done ls: cannot access /var/run/radiusd_traf/radiusd_traf.pid: No such file or directory

Для решения проблемы Вы можете послать сигнал TERM командой kill -15 PID_процесса и заново его запустить.

test_oss_daemons.sh

- test_oss_daemons.sh: ERROR(2) [FAILED]

ALARM ошибка в работе демона OSS

Статус: /usr/local/bin/oss/daemon --global status

Перезапуск: /etc/init.d/oss restart

Для решения проблемы воспользуйтесь статьёй:

http://docs.carbonsoft.ru/51019784#Системамониторинга-testossdaemons.sh

Daemon is not executable: /mnt/var/oss/core/TVIP_Media/init.d/tvipmedia_sync

Исправить проблему автоматически не удалось.

Daemon is not executable (TVIP TMS, TVIPmedia)

Это может возникнуть, если изменился путь до OSS схемы. Например, эта ошибка встречается со схемой TVIPmedia, после переименования в TVIP TMS.

Проблему просто диагностировать и так же просто исправить.

- Для этого, в первую очередь, зайдите в контейнер биллинга:

chroot /app/asr_billing/

[root@carbon ~]# chroot /app/asr_billing/ [root@carbon (asr_billing) /]#

- Попробуйте посмотреть в корневой папке схемы - символические ссылки на OSS схемы делаются обычно на папки целиком:

ls -l /mnt/var/oss/core/TVIP_Media/ | grep -w init.d

[root@carbon (asr_billing) /]# ls -l /mnt/var/oss/core/TVIP_Media/ | grep -w init.d lrwxrwxrwx 1 root root 40 Авг 26 14:35 init.d -> /usr/local/share/oss/tvipmedia_v1/init.d - По выводу видно, что папка со скриптом синхронизации ссылается на папку /usr/local/share/oss/tvipmedia_v1/init.d, а должна на /usr/local/share/oss/tvip_tms_v1/init.d

- Чтобы исправить, выполните небольшой скрипт:

find /var/oss/core/ -type l | xargs ls -l | grep tvipmedia_v1 | awk '{print $9, $11}' | while read link destination; do rm -f $link; ln -s ${destination/tvipmedia_v1/tvip_tms_v1} $link; done

ALARM Billing Не настроены реквизиты доступа к администраторской панели для тестирования

Для ускорения работы веб-интерфейса биллинга, планировщик задач ежечасно делает запрос в веб-интерфейс для формирования кеша и проверки отсутствия ошибок в отображении абонентов.

Для корректной работы требуется администратор с правами root. По-умолчанию, в конфигурационном файле биллинга используются учетные данные root с паролем servicemode.

При изменении пароля root, необходимо исправить так же конфигурационный файл. Либо Вы можете создать нового администратора исключительно для данной функции по статье "Интерфейсы пользователей биллинга" и указать его учетные данные.

/app/asr_billing/cfg/config